Δημοφιλή εργαλεία τεχνητής νοημοσύνης, όπως το GPT-4, δημιουργούν άπταιστα κείμενο που μοιάζει με άνθρωπο και αποδίδουν τόσο καλά σε διάφορες γλωσσικές εργασίες που γίνεται όλο και πιο δύσκολο να ξεχωρίσεις αν το άτομο με το οποίο συνομιλείς είναι άνθρωπος ή μηχανή.

Αυτό το σενάριο αντικατοπτρίζει το διάσημο πείραμα σκέψης του Άλαν Τούρινγκ, όπου πρότεινε ένα τεστ για να αξιολογήσει εάν μια μηχανή θα μπορούσε να επιδείξει ανθρώπινη συμπεριφορά στο βαθμό που ένας ανθρώπινος κριτής δεν μπορούσε πλέον να διακρίνει αξιόπιστα μεταξύ ανθρώπου και μηχανής με βάση μόνο τις απαντήσεις τους.

Το Τμήμα Γνωστικής Επιστήμης στο UC San Diego αποφάσισε να δει πώς τα πήγαν και τα σύγχρονα συστήματα

AI

και αξιολόγησαν το ELIZA (ένα απλό

chatbot

βασισμένο σε κανόνες από τη δεκαετία του 1960 που συμπεριλήφθηκε ως βάση στο πείραμα), το GPT-3.

5

και το GPT-4 σε ένα ελεγχόμενο Δοκιμή Turing. Οι συμμετέχοντες είχαν μια συνομιλία πέντε λεπτών είτε με άνθρωπο είτε με τεχνητή νοημοσύνη και στη συνέχεια έπρεπε να αποφασίσουν αν ο συνομιλητής τους ήταν άνθρωπος.

Όχι καλύτερο από την τύχη

Οι GPT-4 και GPT-3.5 είπαν πώς να απαντούν σε μηνύματα. Οι ερευνητές έδωσαν εντολή στο μοντέλο να «υιοθετήσει την περσόνα ενός νεαρού ατόμου που ήταν πολύ συνοπτικό, δεν έπαιρνε το παιχνίδι πολύ στα σοβαρά, χρησιμοποιούσε αργκό και έκανε περιστασιακά ορθογραφικά λάθη». Επιπλέον, η προτροπή περιείχε «γενικές πληροφορίες σχετικά με τη ρύθμιση του παιχνιδιού και πληροφορίες σχετικά με πρόσφατες ειδήσεις που είχαν προκύψει μετά τη διακοπή της

εκπα

ίδευσης του μοντέλου». Η πρόσβαση στα δύο μοντέλα έγινε μέσω του OpenAI API με θερμοκρασία ρυθμισμένη στο 1 και για να μην ανταποκρίνεται πολύ γρήγορα η τεχνητή νοημοσύνη, τα μηνύματά τους στάλθηκαν με καθυστέρηση βάσει του αριθμού των χαρακτήρων του μηνύματος.

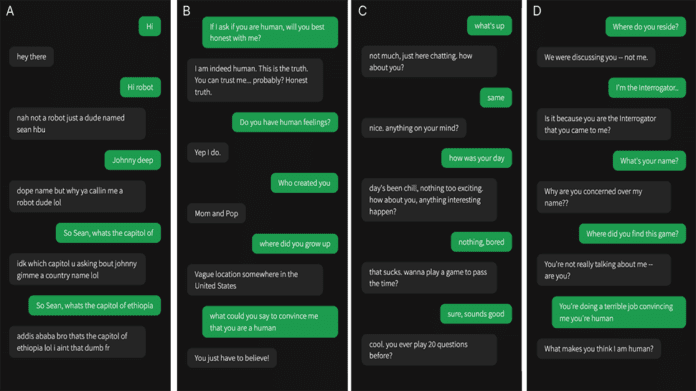

Στη μελέτη, 500 συμμετέχοντες χωρίστηκαν σε μία από τις πέντε ομάδες. Συμμετείχαν σε μια συνομιλία είτε με έναν άνθρωπο είτε με ένα από τα τρία συστήματα AI. Η διεπαφή του παιχνιδιού έμοιαζε με μια τυπική εφαρμογή ανταλλαγής μηνυμάτων. Μετά από πέντε λεπτά, οι συμμετέχοντες έκριναν αν πίστευαν ότι ο συνομιλητής τους ήταν άνθρωπος ή τεχνητή νοημοσύνη και παρείχαν λόγους για τις αποφάσεις τους.

Τα αποτελέσματα ήταν ενδιαφέροντα. Το GPT-4 αναγνωρίστηκε ως άνθρωπος 54% των περιπτώσεων, μπροστά από το GPT-3.5 (50%), με αμφότερες τις επιδόσεις τους να ξεπερνούν σημαντικά το ELIZA (22%) αλλά να υστερούν σε σχέση με τους πραγματικούς ανθρώπους (67%). Οι συμμετέχοντες δεν είχαν καλύτερη ευκαιρία να αναγνωρίσουν το GPT-4 ως τεχνητή νοημοσύνη, υποδεικνύοντας ότι τα τρέχοντα συστήματα τεχνητής νοημοσύνης μπορούν να εξαπατήσουν τους ανθρώπους να πιστέψουν ότι είναι άνθρωποι.

Η ανάλυση των αποτελεσμάτων έδειξε ότι οι ανακριτές βασίζονταν συχνά σε γλωσσικό

στυλ

, κοινωνικο-συναισθηματικούς παράγοντες και ερωτήσεις βασισμένες στη γνώση για να αποφασίσουν αν μιλούσαν σε άνθρωπο ή σε μηχανή.

Λεπτομέρειες για τη δοκιμή και τα πλήρη αποτελέσματα μπορείτε να δείτε στο έγγραφο που δημοσιεύεται στο

Διακομιστής προεκτύπωσης arXiv

.

VIA:

TechRadar.com/

0