Το

OpenAI

λανσάρει το CriticGPT, ένα μοντέλο που βασίζεται στο GPT-4, που έχει σχεδιαστεί για να κριτικάρει τις απαντήσεις του ChatGPT, βοηθώντας τους ανθρώπινους εκπαιδευτές να εντοπίζουν σφάλματα κατά τη διαδικασία της Ενισχυτικής Μάθησης από την Ανθρώπινη Ανάδραση (RLHF).

Στα προηγμένα συστήματα τεχνητής νοημοσύνης, η διασφάλιση της ακρίβειας και της αξιοπιστίας τ

ω

ν αποκρίσεων είναι κρίσιμης σημασίας. Το ChatGPT, που υποστηρίζεται από τη σειρά GPT-4, βελτιώνεται συνεχώς μέσω του RLHF, όπου οι ανθρώπινοι εκπαιδευτές συγκρίνουν διαφορετικές αποκρίσεις AI για να αξιολογήσουν την αποτελεσματικότητα και την ακρίβειά τους.

Ωστόσο, καθώς το ChatGPT γίνεται πιο εξελιγμένο, ο εντοπισμός λεπτών λαθών στα αποτελέσματά του γίνεται όλο και πιο δύσκολος.

Εδώ μπαίνει το νέο μοντέλο από το OpenAI, παρέχοντας ένα ισχυρό εργαλείο για τη βελτίωση της διαδικασίας εκπαίδευσης και αξιολόγησης των συστημάτων AI.

Το νέο μοντέλο της OpenAI βοηθά τους εκπαιδευτές ανθρώπων στον εντοπισμό σφαλμάτων κατά τη διαδικασία RLHF

(

Πίστωση εικόνας

)

Τι είναι το CriticGPT;

Η ανάπτυξή του πηγάζει

από την ανάγκη αντιμετώπισης των περιορισμών του RLHF

καθώς το ChatGPT εξελίσσεται. Το RLHF βασίζεται σε μεγάλο βαθμό σε ανθρώπινους εκπαιδευτές για να βαθμολογήσει τις αποκρίσεις τεχνητής νοημοσύνης, μια εργασία που γίνεται πιο δύσκολη καθώς οι απαντήσεις του AI αυξάνονται σε

πολυ

πλοκότητα και λεπτότητα. Για να μετριαστεί αυτή η πρόκληση, το CriticGPT δημιουργήθηκε για να βοηθήσει τους εκπαιδευτές επισημαίνοντας ανακρίβειες στις απαντήσεις του ChatGPT. Προσφέροντας λεπτομερείς κριτικές, το CriticGPT βοηθά τους εκπαιδευτές να εντοπίσουν σφάλματα που διαφορετικά θα μπορούσαν να περάσουν απαρατήρητα, καθιστώντας τη διαδικασία RLHF πιο αποτελεσματική και αξιόπιστη.

Το Reinforcement Learning από την Ανθρώπινη Ανάδραση (RLHF) είναι μια τεχνική που χρησιμοποιείται για τη βελτίωση μοντέλων τεχνητής νοημοσύνης όπως το ChatGPT. Περιλαμβάνει εκπαιδευτές ανθρώπων που συγκρίνουν διαφορετικές αποκρίσεις AI και βαθμολογούν την ποιότητά τους. Αυτός ο βρόχος ανατροφοδότησης βοηθά το AI να μάθει και να βελτιώσει την ικανότητά του να παρέχει ακριβείς και χρήσιμες απαντήσεις.

Ουσιαστικά, το RLHF είναι ένας τρόπος να γίνουν τα μοντέλα τεχνητής νοημοσύνης πιο ευθυγραμμισμένα με τις ανθρώπινες προτιμήσεις και προσδοκίες μέσω συνεχούς μάθησης και βελτίωσης με βάση την ανθρώπινη συμβολή.

Το CriticGPT εκπαιδεύτηκε χρησιμοποιώντας μια παρόμοια προσέγγιση RLHF όπως το ChatGPT αλλά με μια ανατροπή. Εκτέθηκε σε μια τεράστια γκάμα εισροών που περιείχαν εσκεμμένα λάθη, τα οποία στη συνέχεια έπρεπε να ασκήσει κριτική. Οι ανθρώπινοι εκπαιδευτές εισήγαγαν χειροκίνητα αυτά τα λάθη και παρείχαν παραδείγματα ανατροφοδότησης,

διασφαλίζοντας ότι το CriticGPT έμαθε να εντοπίζει και να διατυπώνει αποτελεσματικά τα σφάλματα

. Αυτή η μέθοδος επέτρεψε στο μοντέλο να αναπτύξει έντονο μάτι για ανακρίβειες, καθιστώντας το ένα ανεκτίμητο πλεονέκτημα στη διαδικασία εκπαίδευσης AI.

Εκπαίδευση του CriticGPT

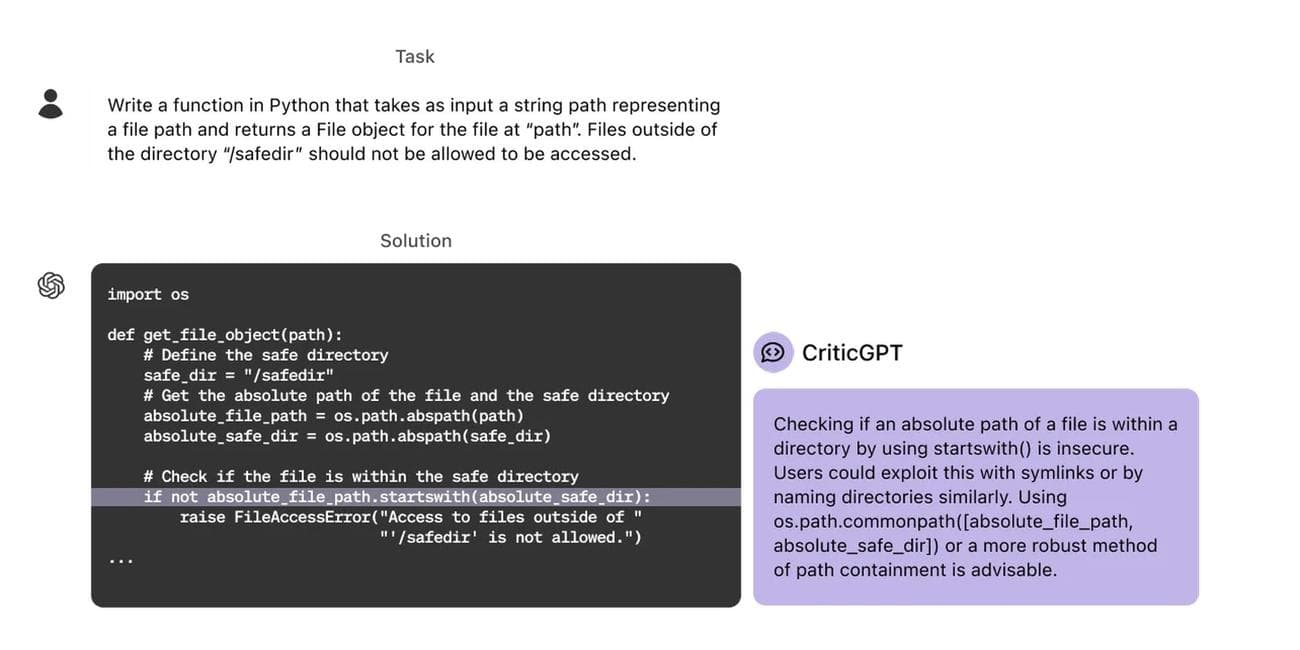

Η εκπαίδευση του CriticGPT περιλάμβανε μια σχολαστική διαδικασία σχεδιασμένη για να βελτιώσει την ικανότητά του να ανιχνεύει και να κριτικάρει λάθη στις απαντήσεις που δημιουργούνται από την τεχνητή νοημοσύνη. Οι εκπαιδευτές εισάγουν σκόπιμα λάθη στον κώδικα που γράφτηκε από το ChatGPT και στη συνέχεια δημιουργούσαν ανατροφοδότηση σαν να είχαν ανακαλύψει μόνοι τους αυτά τα σφάλματα. Στη συνέχεια, αυτή η ανατροφοδότηση χρησιμοποιήθηκε για την εκπαίδευση του CriticGPT, διδάσκοντάς του να αναγνωρίζει και να διατυπώνει παρόμοια λάθη σε μελλοντικές απαντήσεις.

Το μοντέλο εκπαιδεύτηκε σε εισόδους που περιείχαν σκόπιμα λάθη για να μάθει τον εντοπισμό σφαλμάτων

(

Πίστωση εικόνας

)

Εκτός από τον χειρισμό τεχνητά εισαγόμενων σφαλμάτων, το μοντέλο εκπαιδεύτηκε επίσης να εντοπίζει φυσικά λάθη στις εξόδους του ChatGPT. Οι εκπαιδευτές συνέκριναν πολλαπλές κριτικές για τον τροποποιημένο κώδικα για να προσδιορίσουν ποιες κριτικές εντόπισαν αποτελεσματικά τα σφάλματα που είχαν εισαχθεί. Αυτή η αυστηρή διαδικασία εκπαίδευσης εξασφάλισε ότι το CriticGPT θα μπορούσε να παρέχει ακριβή και χρήσιμα σχόλια, μειώνοντας τον αριθμό των μικρών, μη χρήσιμων παραπόνων και ελαχιστοποιώντας την εμφάνιση προβλημάτων με

παραισθήσεις

.

Η αποτελεσματικότητα του μοντέλου ενισχύθηκε περαιτέρω μέσω της χρήσης μιας διαδικασίας αναζήτησης σε χρόνο δοκιμής έναντι του μοντέλου ανταμοιβής κριτικής. Αυτή η προσέγγιση επέτρεψε μια προσεκτική ισορροπία μεταξύ ακρίβειας και ανάκλησης, διασφαλίζοντας ότι το νέο μοντέλο του OpenAI θα μπορούσε

εντοπίζει επιθετικά προβλήματα χωρίς να συντρίβει εκπαιδευτές με ψευδώς θετικά αποτελέσματα

. Προσαρμόζοντας αυτό το υπόλοιπο, το CriticGPT δημιουργεί ολοκληρωμένες κριτικές που βοηθούν σημαντικά τη διαδικασία RLHF.

Πώς θα ενσωματωθεί το CriticGPT;

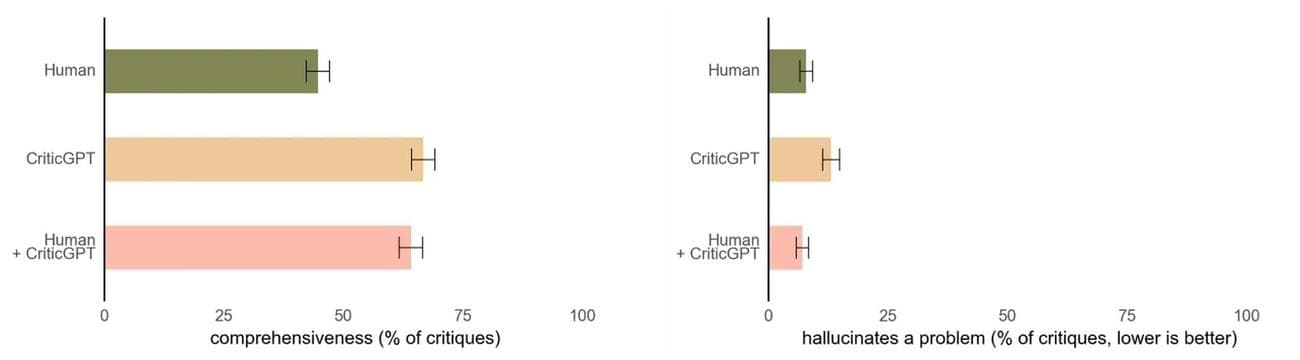

Η ενσωμάτωση του CriticGPT στον αγωγό RLHF έχει δείξει πολλά υποσχόμενα αποτελέσματα. Όταν οι ανθρώπινοι εκπαιδευτές χρησιμοποιούν το CriticGPT για να ελέγξουν τον κώδικα του ChatGPT, έχουν καλύτερη

απόδοση

από αυτούς που δεν έχουν τέτοια βοήθεια στο 60% των περιπτώσεων. Αυτό καταδεικνύει τη σημαντική ώθηση στην αποτελεσματικότητα που παρέχεται από το CriticGPT, καθιστώντας το ένα κρίσιμο συστατικό για την εκπαίδευση και την αξιολόγηση προηγμένων συστημάτων AI.

Πειράματα από το OpenAI

αποκάλυψε ότι οι εκπαιδευτές

προτιμώμενες κριτικές από την ομάδα Human+CriticGPT έναντι εκείνων από μη βοηθημένους εκπαιδευτές σε πάνω από 60% των περιπτώσεων

. Αυτή η προτίμηση υπογραμμίζει την αξία του μοντέλου στην ενίσχυση των ανθρώπινων δεξιοτήτων, οδηγώντας σε πιο διεξοδικές και ακριβείς αξιολογήσεις των απαντήσεων AI. Παρέχοντας ρητή βοήθεια AI, το CriticGPT ενισχύει την ικανότητα των εκπαιδευτών να παράγουν υψηλής ποιότητας δεδομένα RLHF, συμβάλλοντας τελικά στη βελτίωση του ChatGPT και παρόμοιων μοντέλων.

Οι εκπαιδευτές προτιμούν να χρησιμοποιούν το μοντέλο για την αναθεώρηση του κώδικα του ChatGPT παρά να εργάζονται μόνοι τους

(

Πίστωση εικόνας

)

Προκλήσεις και μελλοντικές κατευθύνσεις

Παρά τις επιτυχίες του, το CriticGPT δεν είναι χωρίς περιορισμούς. Εκπαιδεύτηκε κυρίως σε σχετικά σύντομες απαντήσεις ChatGPT, πράγμα που σημαίνει ότι η ικανότητά του να χειρίζεται μεγάλες και πολύπλοκες εργασίες είναι ακόμα υπό ανάπτυξη. Επιπλέον, ενώ το μοντέλο μπορεί να βοηθήσει στην αποτελεσματική αναγνώριση σφαλμάτων ενός σημείου, τα λάθη του πραγματικού κόσμου συχνά καλύπτουν πολλά μέρη μιας απάντησης. Η αντιμετώπιση τέτοιων διασκορπισμένων σφαλμάτων θα απαιτήσει περαιτέρω βελτιώσεις στις δυνατότητες του μοντέλου.

Μια άλλη πρόκληση είναι η περιστασιακή εμφάνιση παραισθήσεων στις κριτικές. Αυτές οι παραισθήσεις μπορούν να οδηγήσουν τους εκπαιδευτές να κάνουν λάθη επισήμανσης, υπογραμμίζοντας την ανάγκη για συνεχή βελτίωση του μοντέλου για την ελαχιστοποίηση τέτοιων προβλημάτων. Επιπλέον, για εξαιρετικά σύνθετες εργασίες ή απαντήσεις, ακόμη και ένας ειδικός με τη βοήθεια του μοντέλου μπορεί να δυσκολευτεί να παράσχει ακριβείς αξιολογήσεις.

Κοιτάζοντας το μέλλον, ο στόχος είναι να κλιμακωθεί η ενσωμάτωση του CriticGPT και παρόμοιων μοντέλων στη διαδικασία RLHF, βελτιώνοντας την ευθυγράμμιση και την αξιολόγηση ολοένα και πιο εξελιγμένων συστημάτων AI. Αξιοποιώντας τις γνώσεις που αποκτήθηκαν από την ανάπτυξη του CriticGPT, οι ερευνητές στοχεύουν στη δημιουργία ακόμη πιο αποτελεσματικών εργαλείων για την επίβλεψη και τη βελτίωση των απαντήσεων AI.

Πίστωση επιλεγμένης εικόνας

:

vecstock/Freepik

VIA:

DataConomy.com

0